Pendant trente-cinq ans, ARM a vendu ses architectures aux autres. Fin mars 2026, la société a brisé son propre modèle : elle fabrique désormais son propre CPU. Et selon Counterpoint Research, ce n’est que le début d’un basculement radical qui, d’ici 2029, verra ARM alimenter 90 % des serveurs IA custom. Intel et x86 regardent passer le train.

A SAVOIR

Le rapport Counterpoint Research porte spécifiquement sur les serveurs AI équipés d’ASIC custom (Google TPU, AWS Trainium, Microsoft Maia, Meta MTIA) — le segment le plus stratégique du cloud IA, là où les hyperscalers concentrent l’essentiel de leurs investissements de 2026 à 2029.

Les faits : ARM lance sa première puce, les géants signent

Le 24 mars 2026, à San Francisco, ARM Holdings a annoncé l’ARM AGI CPU — son premier silicium de production en trente-cinq ans d’existence. Ce n’est plus un design vendu à d’autres fabricants : c’est une puce qu’ARM conçoit, fait fabriquer et vend elle-même. Une révolution de modèle économique autant que technologique.

Les specs sont sérieuses :

- 136 cœurs Neoverse V3 sur deux dies, jusqu’à 3,2 GHz all-core et 3,7 GHz en boost

- 300 W TDP, gravure TSMC 3 nm

- 6 Go/s de bande passante mémoire par cœur, latence sub-100 ns

- 8 160 cœurs par rack 1U air-cooled — et jusqu’à 45 000+ cœurs en liquid-cooled

- 2x le ratio performance/watt face aux meilleures architectures x86 en workload IA

Le carnet de commandes donne le ton : Meta est le client principal, mais derrière se trouvent OpenAI, Cloudflare, Cerebras, SAP, SK Telecom, F5, Positron et Rebellions. La puce sera disponible en production H2 2026 via ASRockRack, Lenovo et Supermicro. Rene Haas, CEO d’ARM, évoque 15 milliards de dollars de revenus projetés d’ici 2031 sur ce segment.

Et ce n’est pas tout. NVIDIA a présenté sa puce Vera à GTC 2026 : 88 cœurs ARM, 1,5x les performances x86 en IA, 3x la bande passante mémoire. AWS développe Graviton + Trainium. Google tourne avec Axion + TPU. Microsoft Azure déploie Cobalt + Maia. La liste des hyperscalers qui abandonnent x86 pour leurs workloads IA est désormais exhaustive.

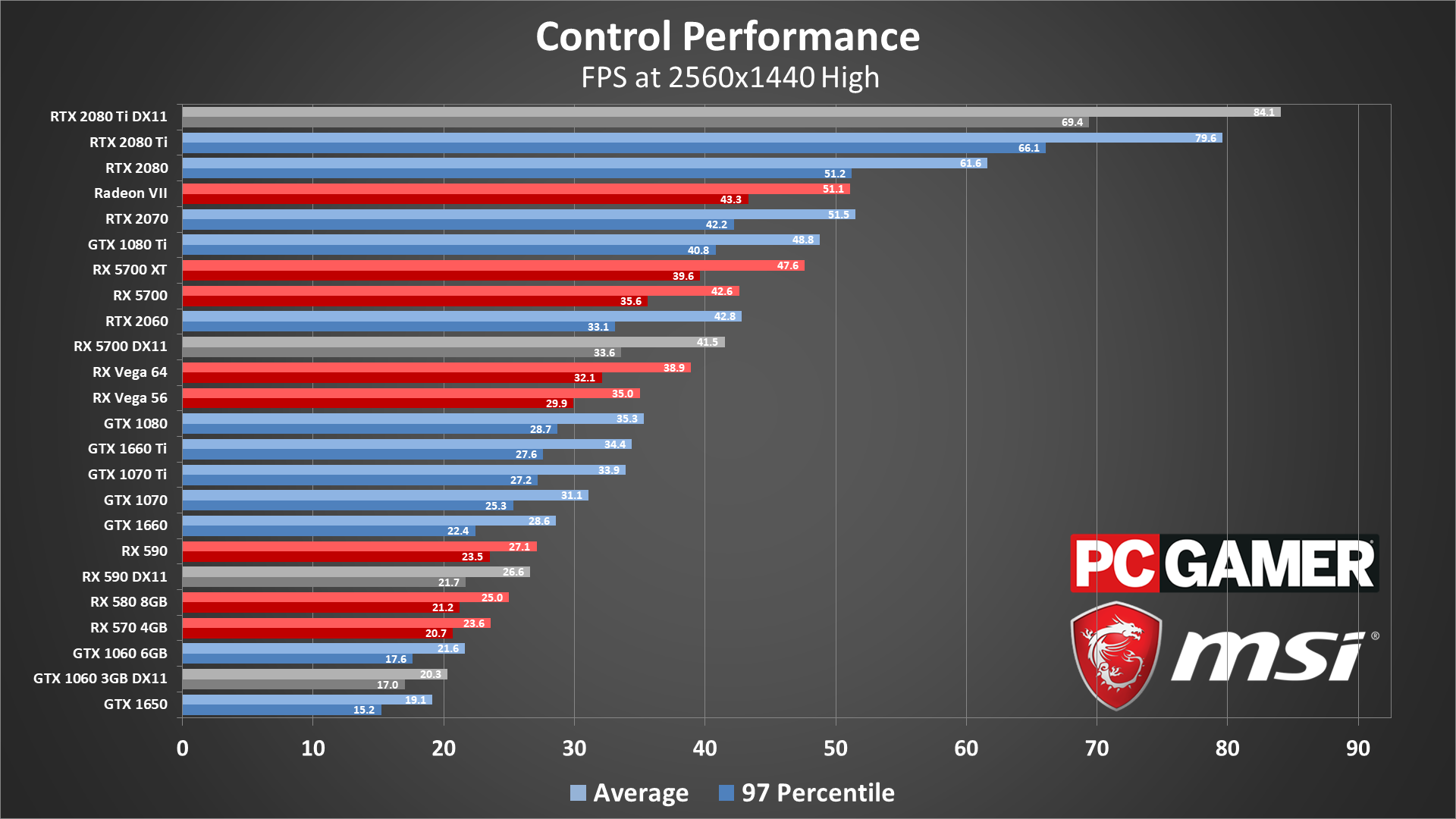

C’est dans ce contexte que Counterpoint Research publie son rapport : la part d’ARM dans les CPU hôtes des serveurs AI ASIC custom passera de ~25 % en 2025 à ~90 % en 2029, avec une accélération dès le second semestre 2026. x86 et RISC-V se partageront les 10 % restants.

Ce que ça change : Intel et AMD mis en minorité dans l’IA

La transition n’est pas une surprise pour les analystes, mais sa vitesse l’est. En quatre ans, ARM passe de marginal à dominant dans le segment le plus dynamique du marché serveur. Pourquoi un tel bascule ? Trois raisons structurelles.

D’abord, l’énergie. Les data centers IA se heurtent à un mur électrique : les États-Unis manquent de transformateurs haute tension, la moitié des projets de centres de calcul prévus sont retardés ou annulés. Dans ce contexte, un ratio performance/watt deux fois supérieur à x86 n’est pas un argument marketing, c’est une nécessité opérationnelle.

Ensuite, le contrôle. AWS, Google, Microsoft et Meta ont investi des milliards pour concevoir leur propre silicium précisément pour ne plus dépendre d’Intel ou d’AMD. Un CPU ARM custom leur donne une maîtrise complète de la roadmap, des optimisations logicielles et — surtout — des marges. Payer une licence ARM coûte infiniment moins cher que d’acheter des Xeon à prix fort.

Enfin, l’écosystème logiciel. Depuis l’explosion des Mac Apple Silicon et de Graviton en cloud, le portage des workloads IA (CUDA via translation, PyTorch natif ARM, compilateurs MLIR) a atteint une maturité suffisante. La barrière qui freinait l’adoption ARM en data center est tombée.

ATTENTION

Le chiffre de 90 % concerne les serveurs AI custom ASIC, pas l’ensemble du marché serveur. Les serveurs d’entreprise traditionnels (ERP, bases de données, virtualisation) resteront majoritairement x86 bien au-delà de 2029. Le tableau est nuancé, mais la tendance est irréversible.

Intel réagit mal. La société n’a pas de réponse crédible dans le segment ASIC custom pour l’IA, et sa roadmap CPU x86 peine à compenser un écart performance/watt qui se creuse chaque trimestre. AMD est dans la même situation, même si la firme prépare sa propre architecture ARM pour les PC Copilot+. RISC-V, malgré son potentiel, reste cantonné à des niches spécialisées.

Notre avis

La décision d’ARM de vendre son propre silicium est l’un des pivots stratégiques les plus importants de la décennie dans les semi-conducteurs. Pendant trente-cinq ans, ARM a joué la carte de la neutralité, vendant ses architectures à tout le monde — y compris à Qualcomm, Apple et Samsung. Entrer dans la vente de puces finales, c’est devenir concurrent de ses propres licenciés. Rene Haas assume le risque ouvertement.

Le rapport Counterpoint confirme ce qu’on voyait venir depuis l’arrivée d’Apple Silicon et l’explosion de Graviton en cloud : x86 n’est pas mort, mais il perd le terrain le plus stratégique et le plus rentable — les workloads IA. D’ici 2029, construire un data center IA sur Intel ou AMD sera une décision d’architecte nostalgique, pas rationnelle.

Pour les acteurs français et européens du cloud, la question concrète est simple : les hyperscalers américains basculent, les OVHcloud et Scaleway de ce monde doivent suivre ou accepter un désavantage structurel en coût et en performance. La transition ARM dans les serveurs IA n’est plus une option, c’est un calendrier.

À surveiller en priorité : la réaction d’Intel lors du prochain Hot Chips, et les premiers benchmarks de production de l’ARM AGI CPU en conditions réelles chez Meta et OpenAI attendus en fin d’année.